Piotr Skulimowski w swoim najnowszym artykule, opublikowanym w czasopiśmie Applied Sciences, opisał jak generatywne modele multimodalne (takie jak LLaVA czy MiniCPM-V) mogą wspomagać analizę scen i wybór parametrów dla algorytmów segmentacji 3D — kluczowych w urządzeniach typu Electronic Travel Aid (ETA) dla osób z dysfunkcją wzroku.

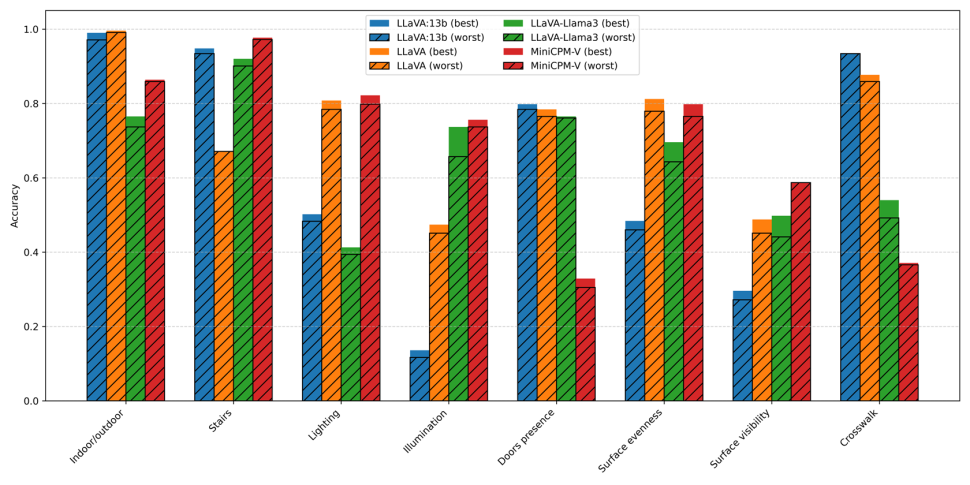

📷 Dzięki analizie zdjęć, AI potrafi określić m.in. czy scena jest wewnętrzna czy zewnętrzna, jakie panują warunki oświetleniowe, czy w kadrze znajdują się przeszkody takie jak schody czy przejścia dla pieszych. To pozwala lepiej dostosować systemy detekcji przeszkód do aktualnego otoczenia i potrzeb użytkownika.

🧠 Artykuł wskazuje również na ograniczenia obecnych modeli — trudności z detekcją subtelnych szczegółów, zmienność wyników i problemy z precyzyjnym formatem odpowiedzi. Mimo to, zastosowanie AI znacząco zwiększa elastyczność i adaptacyjność systemów wspierających poruszanie się osób niewidomych.

💡 Badanie to krok w stronę integracji nowoczesnych modeli AI z systemami wspomagającymi samodzielność — szczególnie tam, gdzie liczy się kontekst, a nie tylko precyzyjna klasyfikacja.

✒️ Pełny tekst artykułu dostępny jest na stronie:

Piotr Skulimowski "Application of Multimodal AI to Aid Scene Perception for the Visually Impaired", Appl. Sci. 2025, 15, 6442. https://doi.org/10.3390/app15126442

Wersja PDF: https://www.mdpi.com/2076-3417/15/12/6442/pdf